Voor bestrijding van desinformatie moet je eerst bij de ontvangers zijn

Ze slalommen in slechts 136 pagina’s, plus 40 pagina’s aan bronvermeldingen, door het scala van onderzoek over ‘misinformation’ in allerhande varianten, om te eindigen bij eigen veldonderzoek. Dat ze overigens ter discussie durven te stellen, want relativering en ironie zijn Roozenbeek en Van der Linden niet vreemd.

Factchecken met beperkt effect

Bij mij viel het bovendien in vruchtbare aarde vanwege de nadruk op onvermogen om de verspreiding van onjuistheden met wortel en tak uit te roeien. Tien jaar geleden was ik al sceptisch over de pogingen van brave idealisten, bijvoorbeeld van nrc.next van Rob Wijnberg, die met hun factchecks de mediawereld kwamen verbeteren. Anderen deden het fout, want journalisten die tuk zijn op missers van anderen. Iets met balk en splinter of hypocrisie. Vijf jaar geleden publiceerden we Factchecken: dweilen met de kraan open.

Universiteit Leiden voert het front van factcheckers nog steeds dapper en kundig aan met Nieuwscheckers, maar het succesvol aanboren van subsidie staat in geen verhouding tot het effect van de noeste arbeid.

De reden? Wie bevattelijk is voor onjuiste informatie, om niet te zeggen daar behoefte aan heeft - om welke sociaalpsychologische kortsluiting dan ook - verlaat zich liever op de fantasierijke complotdenkers etc. dan op die ‘journalistieke feitenneukers’, die in de ogen van argwanend publiek allesbehalve onafhankelijk zijn.

Breed spectrum

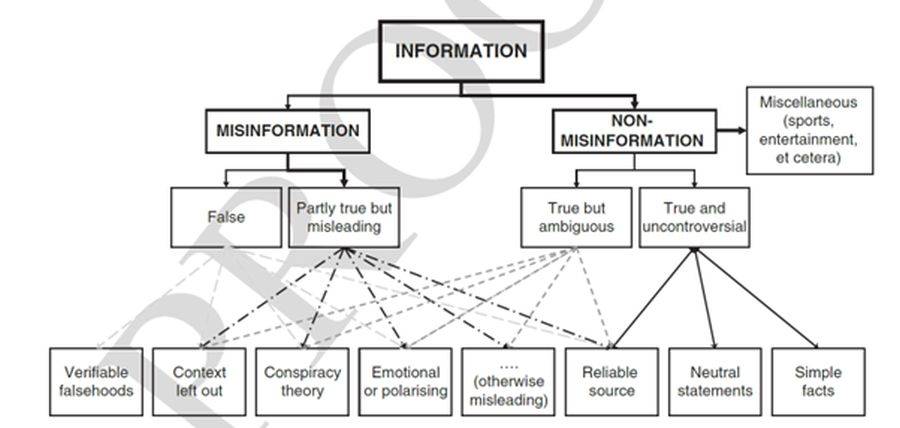

Eenvoudigweg spreken over nepnieuws of desinformatie is niets voor wetenschappers zoals Roozenbeek en Van der Linden. Ze bezien het fenomeen terecht in verschillende gradaties van afwijkingen van de waarheid: van complete en direct traceerbare onzin tot slinkse propaganda die we niet als zodanig herkennen. Of hoe zit het bijvoorbeeld met reclame?

Helaas wordt dat laatste niet expliciet geadresseerd in de volgende figuur, ofschoon die prachtig het spectrum weergeeft van de mate van misleiding:

Het probleem zit vooral in de overlap tussen misleidende, maar gedeeltelijk ware misinformatie versus de juiste maar dubbelzinnige ‘niet-misinformatie’. Deze categorieën van ‘een beetje waar’ lijkt alsmaar groter te worden, vooral door het circus van vaak beperkt onderbouwde meningen. Serieuze media dragen hieraan dus evenzeer bij.

De grote spreiding van verschillende vormen maakt het nauwgezet definiëren moeilijk. De definitie van de auteurs: “Verkeerde informatie is informatie die onjuist of misleidend is, ongeacht de intentie of de bron.”

Juist, maar toch misleidend

Humor soms: The Onion (De Speld van de VS) bracht het nieuws: “Kim Jong-Un Named The Onion's Sexiest Man Alive For 2012”. People’s Daily, de krant van de Chinese Communistische Partij, nam het groot en triomfantelijk over als serieus nieuws. Ook opzettelijk foppen slaagt soms, vroeger bij ons met de inmiddels uitgestorven 1 april grappen.

En, zo benadrukken de auteurs, zelfs volkomen juiste informatie kan misleiden. Neem het bericht in Chicago Tribune dat een tegen Covid gevaccineerde arts overleden was en onderzoek plaatsvond. Compleet juist maar miljoenen keren gedeeld als ‘bewijs’ van niet- of zelfs averechts werkende vaccins. De doodsoorzaak was echter niet Covid-19 noch de vaccinatie. Dit noemen de auteurs ‘malinformation’: feitelijk juist, maar misbruikt in andere context.

We zien het al te vaak met ‘framing’, valse beeldvorming of een vorm van beeld die een groot risico heeft op curieuze of onjuiste interpretaties. Dit is een belangrijk onderwerp voor Netkwesties, bijvoorbeeld met boek en serie van de familie Blom.

Lange geschiedenis

Dit is al zo oud als de mensheid. Onderzoeker Joanna Burkhardt onderscheidt vier periodes van desinformatie: vóór en na de uitvinding van boekdrukkunst, het massamedia- en tenslotte internettijdperk. Overigens, de dierenwereld was ons voor met misleiding met valse informatie.

Vervolgens behandelen de Nederlandse onderzoekers literatuur waarin de invloed van desinformatie op de samenleving als overdreven wordt gezien. Er zijn weinig studies die het causale verband tussen verkeerde informatie en gedrag hard aantonen. Als dit verband bestaat, lijkt het zwak. Bijvoorbeeld met verkiezingen, want de tv is dominant voor meningsvorming en online nepnieuws niet. Echter, een minderheid aan kiezers is tuk op nepnieuws en verantwoordelijk voor het intensief rondpompen ervan.

Onderzoekers stellen dat bij nieuwe technologie steeds weer paniek uitbreekt die onterecht blijkt, zoals met de komst van ‘deepfakes’ (Het boek werd voltooid alvorens de AI-hype uitbrak, maar daar zien we het doemdenken over overvloedig nepnieuws niet bewaarheid.)

Aan de andere kant, zeggen Roozenbeek en Van der Linden, zijn sommige verkeerde opvattingen hardnekkig en invloedrijk, zoals over de fraude van de presidentsverkiezingen in de VS in 2020. Of dat China het Covid-virus met opzet fabriceerde en verspreidde vanuit Wuhan. Of neem het aanhoudende geloof in onbewezen therapieën, zoals voor kanker, of argwaan over gevolgen van vaccinatie tegen baarmoederhalskanker. Of erger nog: Russische propaganda over Oekraïne vanaf 2014.

Complotbehoefte

Deel II vind ik het boeiendst, omdat het beschrijft hoe en waarom, ongeacht het aanbod, er bij mensen een sterke behoefte kan groeien aan gedeelde argwaan en complotten. Dat is niet eenvoudig verklaarbaar. Veel factoren bepalen de individuele verwerking van informatie: sociale omgeving, analytisch en ruimdenkend ingesteld zijn, politieke partijdigheid, vertrouwen in media, polarisatie, psychologische aantrekkingskracht, herhaling, emoties en groepsgevoel.

Op grond van bovenstaande indeling in soorten valse informatie kritiseren Roozenbeek en Van der Linden onderzoek gericht op evident nepnieuws. Immers, manipulatie door minder klare vervalsingen met – verholen - gekleurde informatie komt vaker voor. Juist de misleiding met halve waarheid (of kwart of driekwart) vormt vaak een probleem.

Internet intensiveert het delen van bedenkelijke informatie in ‘echokamers’ (Cass Sunstein, Republic.com) en luchtbellen (Eli Pariser). Al in de Macht van Facebook vond ik dit effect overdreven; mensen blijven informatie buiten hun cirkel tot zich nemen, als is het maar uit ergernis en om op te reageren. Onderzoek toont aan dat het effect van isolatie van mensen in eigen kringen meevalt. De informatievoorziening verloopt breed. Anderzijds nemen de auteurs pessimistische voorspellingen over isolatie, polarisatie en manipulatie serieus, evenals nare gevolgen. Rusland is het beste voorbeeld.

Bestrijdingsmiddelen

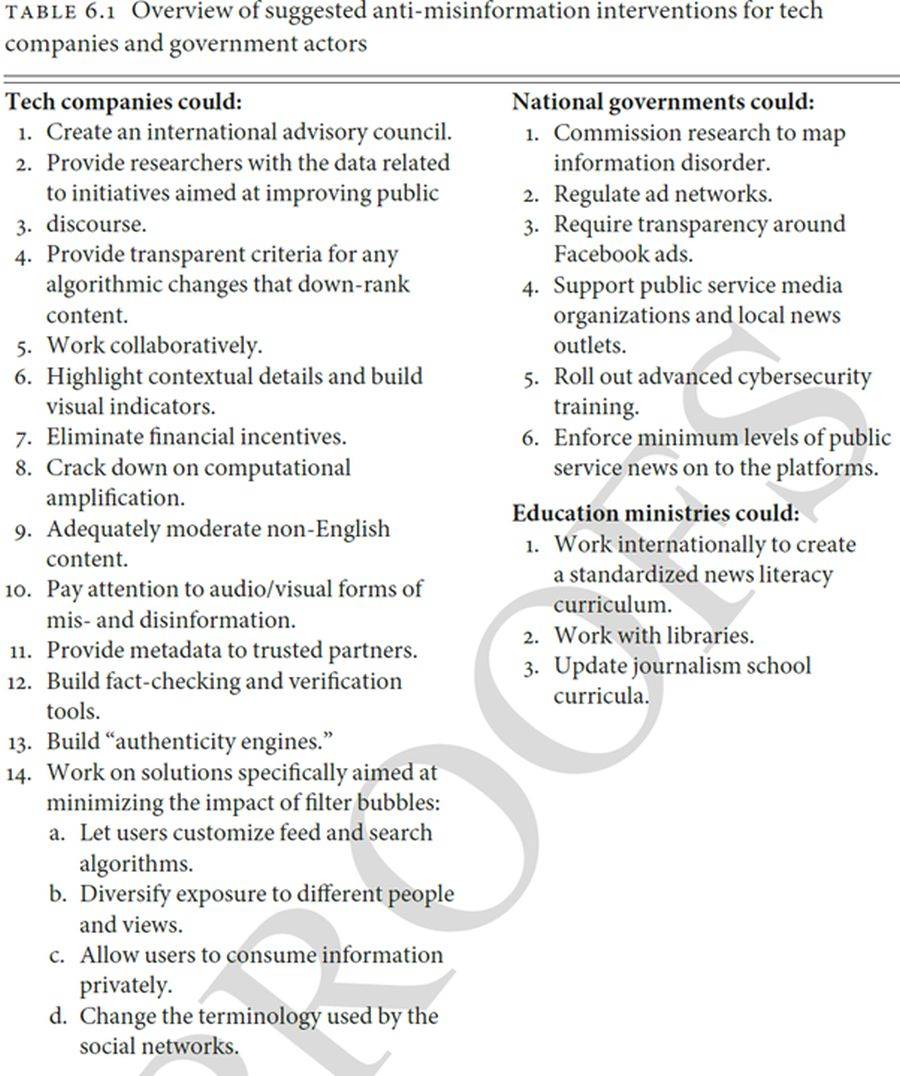

Deel III van ‘Misinformation’ behelst de bestrijding met wetten regels door overheden in de Europese Unie, Engeland en de Verenigde Staten. (Met als disclaimer dat de auteurs geen jurist zijn en in hun jeugd regels tartten, bijvoorbeeld met het niet-betalen voor Amsterdams OV). Ze citeren Information Disorder, een werkprogram voor de EU geschreven door Claire Wardle en Hossein Derakhshan, met de volgende opsomming van bestrijdingsmiddelen tegen misinformatie:

Je kunt beter platforms tot doelwit te nemen en niet het maken en verspreiden van desinformatie strafbaar stellen. Dat laatste poogden regeringen niettemin wel te doen, zoals in Italië, Griekenland, Hongarije, Polen en Frankrijk, en ook Rusland en China. Ze proberen makers te vervolgen.

Censuur ligt hoe dan ook op de loer, want wie bepaalt wat valse informatie is en op welke gronden? Als je platforms aansprakelijkheid maakt, ontstaan er ongewenste prikkels. Ze lopen immers wel het risico op een boete als ze uitingen niet verwijderen, maar als ze niet-illegale inhoud toch weghalen (censuur), staat daar geen repercussies op.

Gereedschapskist

Deze balanceeract speelt in Brussel. De Digital Services Act (DSA) voorziet in verplicht schoonvegen voor platforms, maar definieert zelf geen illegale inhoud. Die staat in andere EU- en/of nationale wetgeving, bijvoorbeeld tegen terrorisme en haatzaaien. De Code of Practice on Disinformation, een niet-bindende overeenkomst tussen technologieplatforms, adverteerders en fact-checkers, voorziet in invulling als zelfregulering onder streng toezicht van de EU. De DSA maakt onderscheid tussen illegaal en schadelijk maar niet illegaal (‘lawful but awful’).

Platforms moeten wettelijk risico’s indammen van desinformatie, hoaxes en manipulatie. Engeland kent de Online Safety Bil. De auteurs: “Deze kaders ontmoetten veel kritiek omdat ze tegelijkertijd te verstrekkend en relatief tandeloos zouden zijn. De effectiviteit moet nog worden aangetoond.”

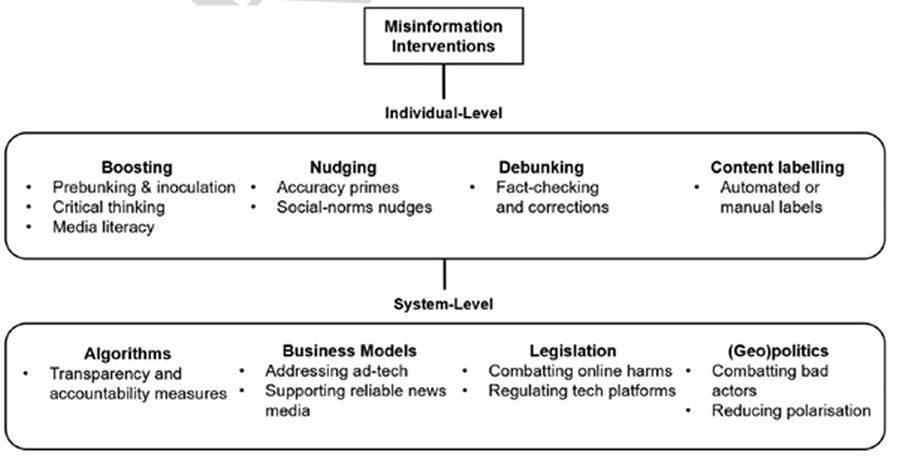

Allerhande interventies om consumptie en verspreiding van desinformatie te bestrijden staan in een Gereedschapskist voor Interventie. Auteur Jon Roozenbeek en collega’s maakten eerder deze figuur:

Het voert te ver om alles te bespreken. Spelletjes helpen zoals Cranky Uncle voor de jeugd. Sites voor ontkrachting en feitenchecks zoals Snopes en FullFact en StopFake trekken miljoenen bezoekers, maar de laatste (een EU-subsidiekonijn) gooide de handdoek al in de ring. Het labelen van nepnieuws biedt evenmin veel soelaas.

Resultaten van interventies zijn dus veelal twijfelachtig volgens Roozenbeek en Van der Linden, te meer gezien de (eerdergenoemde) grote marge tussen exact juiste een totaal onjuiste berichten. Veel geklets zit ertussenin, moeilijk te definiëren, traceren en bestrijden. Veel meer hard veldonderzoek is nodig.

Open armen

Tot slot behandelen ze eigen onderzoek, allerminst gespeend van zelfkritiek. GetBadNews zette Roozenbeek op met Ruurd Oosterwoud (bekend het leuke maar inmiddels gesneefde Drog) deed het aardig. Ze maakten meer spellen, zoals Harmony Square en Cat Park voor de Amerikaanse overheid, en deden onderzoek naar gebruik en effect. Effecten waren substantieel, deelnemers werden argwanender voor onjuiste uitingen, maar onderzoek was niet altijd goed genoeg.

Ze mochten van Google een uitgebreide studie doen op YouTube. Op Inoculation.science staat een serie toegepaste video’s voor bewustmaking van manipulatie. In een studie vergeleken onderzoekers vervolgens twee groepen twitteraars: degenen die de video’s zagen en degenen die ze niet zagen. Verschil in emoties van tweets tussen de beide groepen was echter niet direct aantoonbaar.

Latere studies waren beter, ook in samenwerking met de grote platforms van Google en Meta en in samenwerking met de WHO, maar heel positief zijn de auteurs daar nog niet over. Er moet nog meer breder en diepgaander onderzoek komen naar de invloeden en effectieve bestrijding van invloed van misinformatie, vooral bij de ontvangers.

*) "The Psychology of Misinformation", Jon Roozenbeek en Sander van der Linden, Cambridge University Press, 2024 (ook via Libris)

**) Beeld: Pieter van Lint, Heilige familie met Engel, 1625 - 1650, Noord-Brabants Museum (aangekocht door Vereniging Rembrandt)